Warum Intelligenz so schwer zu definieren ist

Intelligenz klingt nach einem einfachen Wort – bis man versucht, es genau zu fassen. Geht es um die Grösse des Gehirns, die Anzahl der Neuronen, die Fähigkeit, Probleme zu lösen oder um das Selbstbewusstsein? Unterschiedliche Disziplinen geben unterschiedliche Antworten. Psychologen untersuchen Denken und Gedächtnis. Neurowissenschaftler verweisen auf neuronale Netzwerke. Evolutionsbiologen betonen die Anpassungsfähigkeit in freier Wildbahn.

Und heute, mit künstlicher Intelligenz, bringen Informatiker noch eine weitere Perspektive ein: Benchmark-Scores, Trainingsdaten und Modellparameter. Bei S-PRO arbeiten wir täglich mit KI und stossen oft auf diese Frage von Kunden: Was bedeutet es eigentlich, wenn ein System „intelligent“ ist? Das ist kein theoretisches Rätsel. Die Antwort bestimmt, wie KI-Produkte entworfen, getestet und eingesetzt werden.

Philosophen, Neurowissenschaftler und KI-Forscher haben versucht, den Begriff Intelligenz zu fassen. Richard Dawkins beschrieb sie als die Fähigkeit, sich an neue Situationen anzupassen, aus Erfahrung zu lernen und abstrakte Konzepte einzusetzen, um mit der Umwelt zu interagieren. Es geht weniger um ein grosses Gehirn als um Flexibilität in Denken und Handeln.

Nicklas Boström, ein führender Denker in der KI-Forschung, unterscheidet vier Stufen: menschliche, künstliche und die noch nicht existierende „übermenschliche“ Intelligenz, die eines Tages unsere übertreffen könnte. Diese Leiter zeigt: Definitionen sind entscheidend. Wenn wir über „KI“ sprechen, dehnen wir den Begriff bereits aus – auf Systeme, die berechnen, vorhersagen und uns manchmal überraschen. Aber sie denken immer noch nicht wie wir.

Fluide vs. kristallisierte Intelligenz

Der Psychologe Raymond Cattell führte eine nützliche Unterscheidung ein: fluide vs. kristallisierte Intelligenz. Fluide Intelligenz bedeutet Problemlösung in Echtzeit – etwa ein Puzzle lösen oder eine unbekannte Stadt navigieren. Kristallisierte Intelligenz basiert dagegen auf Wissen: auf Fakten, Vokabeln und gesammelten Erfahrungen.

Fluide Intelligenz ist die Fähigkeit, neue Probleme zu lösen, Muster zu erkennen und sich anzupassen. Kristallisierte Intelligenz ist gespeichertes Wissen – Fakten, Fähigkeiten und Routinen. Menschen nutzen beides. Ein Kind, das ein neues Puzzle löst, zeigt fluide Intelligenz. Wer sich im Geschichtsunterricht an Daten erinnert, greift auf kristallisiertes Wissen zurück.

Tiere zeigen beides auf überraschende Weise. Eine Krähe, die einen Draht biegt, um an Futter zu gelangen, zeigt fluide Intelligenz. Ein Hund, der Dutzende Kommandos befolgt, stützt sich auf kristallisierte Intelligenz. Maschinen dagegen sind stark auf kristallisierte Intelligenz ausgerichtet. Sie reproduzieren Muster aus Trainingsdaten mit hoher Genauigkeit, tun sich aber schwer mit echter Anpassungsfähigkeit.

Für Unternehmen ist diese Unterscheidung entscheidend. Maschinen glänzen heute bei kristallisierter Intelligenz. Datenbanken und grosse Sprachmodelle können riesige Mengen an Information speichern und abrufen. Doch fluide Intelligenz – also die Fähigkeit, sich in neuen, unsicheren Kontexten anzupassen – bleibt für KI schwer. Das erklärt, warum Ihr Smartphone Ihnen jede Hauptstadt der Welt nennen kann, aber bei einem kniffligen Rätsel ins Stolpern gerät.

Wenn wir KI-Lösungen entwerfen, helfen wir Kunden zu klären, ob sie kristallisierte Systeme brauchen (z. B. für Wissensabruf oder Dokumentenautomatisierung) oder fluide Fähigkeiten (z. B. für adaptive Entscheidungsunterstützung). Beides gleichzusetzen führt schnell zu falschen Erwartungen und gescheiterten Projekten.

Zählt die Anzahl der Neuronen als Intelligenz?

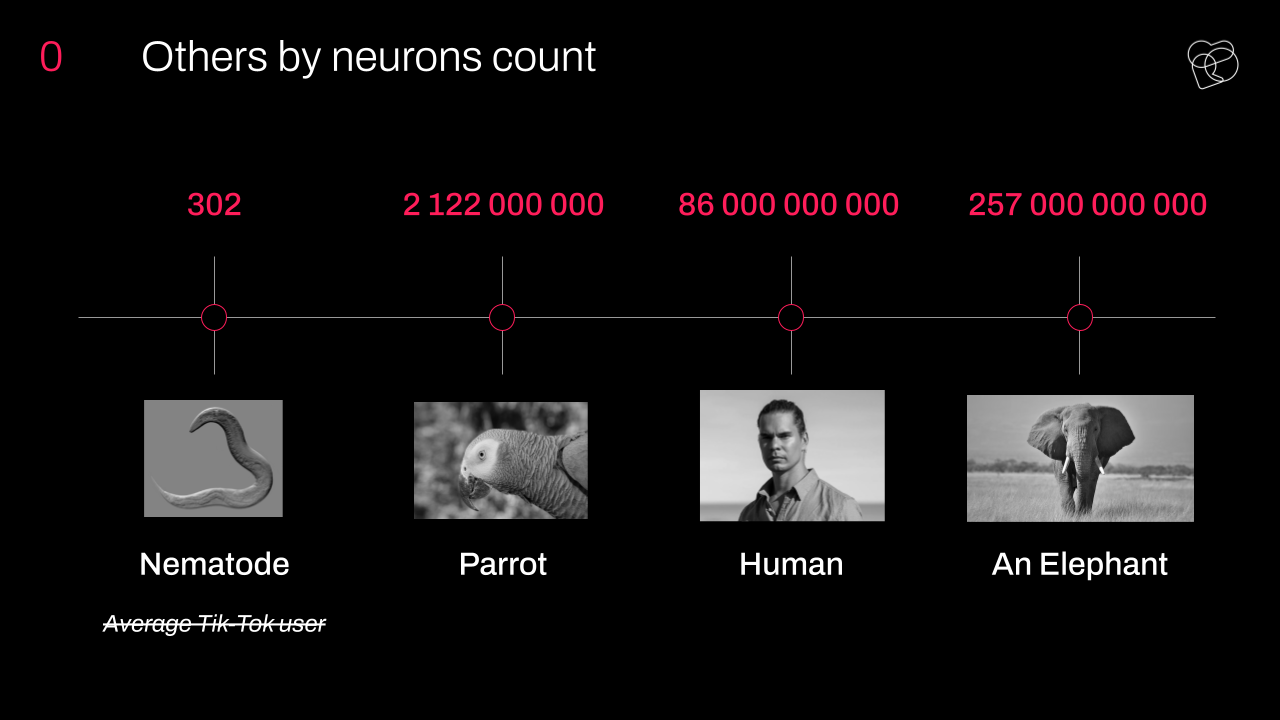

Es liegt nahe anzunehmen: mehr Neuronen = mehr Intelligenz. Immerhin hat das menschliche Gehirn rund 86 Milliarden davon, verteilt auf sechs Schichten im Kortex. Doch die Biologie macht diese einfache Rechnung kompliziert.

Nehmen wir Aplysia depilans, eine Meeresschnecke mit nur 20.000 Neuronen. Trotzdem kann sie lernen, vor Fressfeinden zu fliehen und Nahrung suchen. Ihr Nervensystem ist so überschaubar, dass Wissenschaftler viele ihrer Schaltkreise detailliert kartiert haben – ein Modellorganismus zur Erforschung von Gedächtnis.

Oder Papageien: Mit etwa zwei Milliarden Neuronen, also deutlich weniger als Menschen oder Elefanten, können sie Sprache imitieren, Probleme lösen und sogar Werkzeuge erfinden. Elefanten hingegen haben erstaunliche 257 Milliarden Neuronen – und doch komponieren sie keine Symphonien und bauen keine Wolkenkratzer. Offenbar ist die reine Zahl nicht ausschlaggebend.

Das gilt auch für KI. Moderne Modelle haben heute Milliarden künstlicher „Neuronen“. Doch Grösse allein macht sie weder anpassungsfähig noch kreativ oder bewusst. Für Unternehmen, die mit KI arbeiten, lautet die Lehre: Grösser heisst nicht automatisch klüger. Architektur, Trainingsdaten und Anwendungskontext sind genauso wichtig wie die Grösse.

Bewusstsein vs. Intelligenz

Auch in diesen Kategorien bleibt eine grosse Unterscheidung: Intelligenz ist nicht dasselbe wie Bewusstsein.

Intelligenz bedeutet, Probleme zu lösen. Bewusstsein bedeutet subjektive Erfahrung – das Gefühl, wie es ist, etwas zu sein. Wo fängt das eine an, wo hört das andere auf?

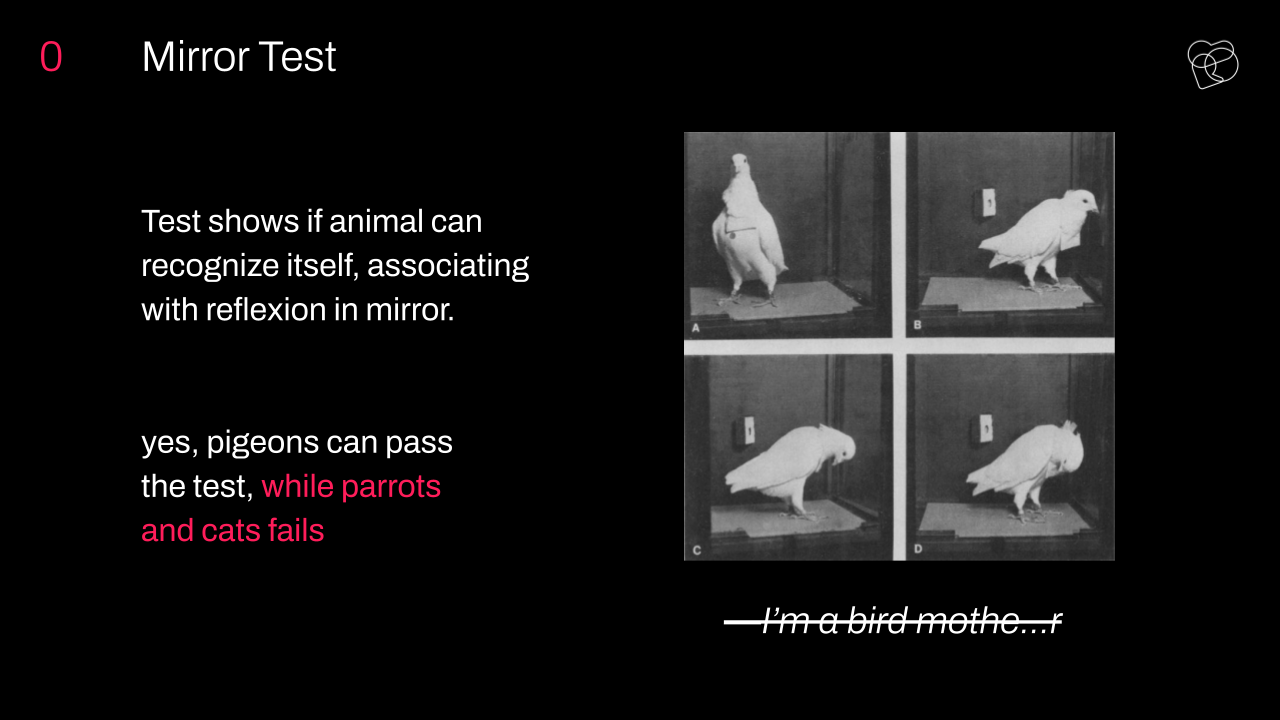

Wissenschaftler versuchen, dies mit dem Spiegeltest zu untersuchen: Er zeigt, ob ein Tier sich selbst im Spiegel erkennen kann. Menschen bestehen in der Regel ab etwa 18 Monaten. Delfine, Elefanten und manchmal auch Tauben bestehen ihn ebenfalls. Katzen, Papageien oder andere Vögel fallen meist durch. Bedeutet das, Katzen seien weniger intelligent? Oder zeigt es nur, dass Selbstwahrnehmung ein sehr enger Massstab für Bewusstsein ist? Bestehen beweist kein volles Bewusstsein, aber immerhin eine Form von Selbsterkennung.

Der Philosoph David Chalmers nennt dies das „harte Problem des Bewusstseins“: zu erklären, warum physische Prozesse im Gehirn zu subjektiven Erlebnissen führen. Warum löst die Verarbeitung von Licht in uns Farben aus, statt nur auf Wellenlängen zu reagieren? Maschinen können heute Intelligenz simulieren, aber sie haben keine innere Perspektive.

Eine Annäherung ist, die Eigenschaften von Bewusstsein aufzulisten, etwa:

- Wahrnehmung der Umwelt durch Gefühle, Erfahrungen und körperliche Bedürfnisse;

- Reflexion und Selbsterkenntnis auf Basis neuer Erfahrungen und Wissens;

- kontinuierliche Anpassung und Selbstentwicklung, Entdeckung neuer Qualitäten unter Druck und widersprüchlichen Bedürfnissen;

- Innerer Konflikt, der uns zur Anpassung zwingt und Wachstum antreibt.

Für Organisationen, die KI erforschen, ist diese Unterscheidung wichtig. Wenn jemand fragt, ob KI „denkt“ oder „versteht“, lautet die richtige Antwort: Sie verarbeitet, prognostiziert und empfiehlt – nicht mehr.

Warum das für KI wichtig ist – und wie Maschinen in das Spektrum passen

Bei S-PRO treffen wir oft Kunden, die fragen: „Wann wird KI bewusst?“ Doch diese Frage greift zu kurz. Systeme, die wir entwerfen, müssen kein Bewusstsein haben, um Wert zu schaffen. Sie brauchen Intelligenz – die Fähigkeit, Muster zu lernen, Probleme zu lösen und sich sinnvoll anzupassen.

Maschinelle Intelligenz ist auf Effizienz und Optimierung ausgelegt. Sie nimmt in dieser Debatte ihre eigene Nische ein. Maschinen übertreffen den Menschen in kristallisierten Bereichen wie Schach, Übersetzung oder Mustererkennung. Ihre künstlichen „Neuronenzahlen“ erreichen inzwischen Milliarden. Doch sie fehlt sowohl fluide Anpassungsfähigkeit als auch Bewusstsein.

Darum ist es mehr als eine akademische Diskussion, diese Unterschiede zu verstehen. Sie leiten technische Entscheidungen. Wenn wir KI für Branchen wie Finanzen oder Gesundheitswesen entwickeln, geht es nicht um Neuronenzahlen oder Spekulationen über „Maschinenseelen“. Wir bauen Systeme, die in klaren Definitionen von Intelligenz arbeiten – und die philosophische Lücke des Bewusstseins anerkennen.

Für uns als Softwareentwicklungsunternehmen ist die Lehre praktisch: Die richtige Frage lautet nicht „Kann KI die menschliche Intelligenz erreichen?“, sondern „Welche Art von Intelligenz braucht dieses Unternehmen, um zu skalieren?“ In diesem Licht ist Intelligenz weniger eine Hierarchie als ein Spektrum – und die klügste Entscheidung ist zu wissen, welchen Teil dieses Spektrums man nutzen sollte.